O ChatGPT agora consegue ver, falar,ouvir, percebe e responde

A OpenAI lança um novo capítulo do ChatGPT com funcionalidades multimodais.

O ChatGPT agora consegue ver as suas imagens, ouvir a sua voz e responder às suas perguntas com uma voz semelhante à humana.

A multimodalidade, ou seja, a capacidade de processar imagens e voz, além de texto, finalmente chegou.

Aqui está o que precisa de saber:

Voz

• Agora pode utilizar a voz para participar em conversas de ida e volta com o ChatGPT e utilizá-lo como assistente.

• Pode ativar a voz na secção de Novas Funcionalidades nas Configurações. Pode então escolher entre 5 vozes diferentes.

• Pode ouvir amostras de voz aqui.

Imagens

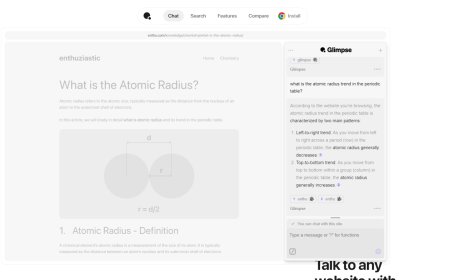

• Vai poder tirar ou carregar imagens para o ChatGPT e fazer perguntas sobre a imagem.

• As perguntas podem variar desde o motivo pelo qual o seu grelhador não está a funcionar até ao significado de um gráfico.

• Vai poder focar-se e fazer perguntas sobre uma parte específica da imagem utilizando a ferramenta de desenho.

• Também vai poder carregar capturas de ecrã e documentos que contenham tanto texto como imagens.

• Pode ver um vídeo de demonstração da funcionalidade aqui.

Ambas as funcionalidades estarão disponíveis dentro de 2 semanas para os utilizadores ChatGPT Plus e Enterprise.

Os desenvolvedores também terão acesso no futuro. Pode obter mais detalhes sobre as novas funcionalidades aqui.

Qual é a sua reação?